快速入门指南

1、云端创建边缘节点

打开边缘节点页面

节点目前区分容器模式与进程模式,可根据需要创建相应模式的节点,点击 创建节点,填写边缘节点信息:

- 名称:节点名称,不可为空,不可重复

- 描述:节点描述信息,可为空

- 节点类型:单机或集群

-

AI加速卡:根据需安装节点的目标机器上的AI加速卡类型选择,默认无,目前支持以下类型:

- Nvidia GPU (amd64)

- Nvidia Jetson (arm64)

- 比特大陆SE5

- 华为昇腾310

- 百度昆仑

- 寒武纪思元270

- 标签:KV键值对,可选

- 认证方式:默认为证书认证

2、边缘侧安装

2.1 边缘节点环境准备

BIE边缘计算框架依赖k3s/k8s环境,考虑到边缘节点资源限制,推荐使用k3s,它是面向边缘计算设计的轻量级k8s,并保留了k8s的核心特性。

k3s的容器运行时可以使用docker或者containerd,本节介绍如何安装k3s以及对应的运行时。

关闭swap

为了性能考虑,不论安装k3s和k8s,都需要提前关闭swap。

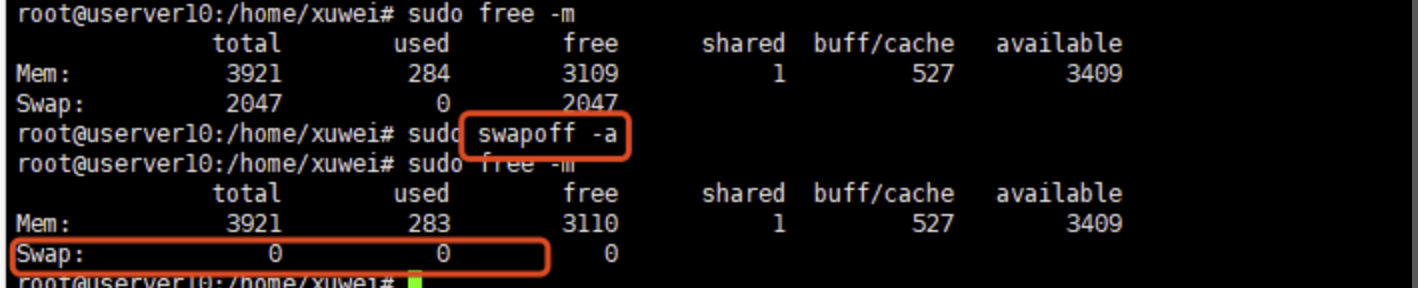

临时关闭

- 禁用命令:sudo swapoff -a

- 启用命令:sudo swapon -a

- 查看交换分区的状态: sudo free -m

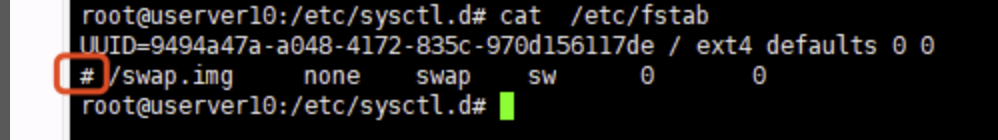

永久关闭

永久关闭swap后,系统需要重启。虚拟机内存分配建议调整到2G以上,否则会导致图形界面难以进入。

关闭方式:

1、sudo vim /etc/fstab

2、将swap那行注释。

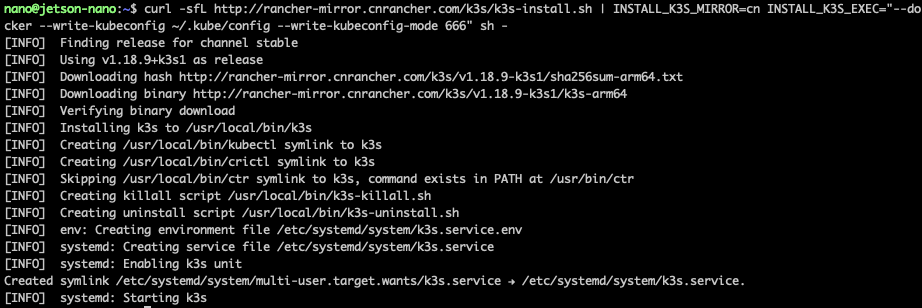

安装k3s+containerd

k3s的默认容器运行时是containerd,执行以下命令自动安装k3s和containerd并启动。

1curl -sfL https://rancher-mirror.oss-cn-beijing.aliyuncs.com/k3s/k3s-install.sh | INSTALL_K3S_MIRROR=cn INSTALL_K3S_VERSION=v1.22.5+k3s1 INSTALL_K3S_EXEC="--no-deploy traefik --no-deploy local-storage --write-kubeconfig ~/.kube/config --write-kubeconfig-mode 666" sh -安装k3s+docker

如果需要使用docker作为k3s的容器运行时,需要先安装docker环境,执行以下命令安装docker:

1# 安装docker

2curl -sSL https://get.daocloud.io/docker | sh

3# 执行docker命令免sudo

4sudo usermod -aG docker "$USER"

5# 查看docker信息

6docker info执行一下命令安装k3s,并使用docker作为默认容器运行时启动k3s:

1curl -sfL https://rancher-mirror.oss-cn-beijing.aliyuncs.com/k3s/k3s-install.sh | INSTALL_K3S_MIRROR=cn INSTALL_K3S_VERSION=v1.22.5+k3s1 INSTALL_K3S_EXEC="--no-deploy traefik --no-deploy local-storage --docker --write-kubeconfig ~/.kube/config --write-kubeconfig-mode 666" sh -

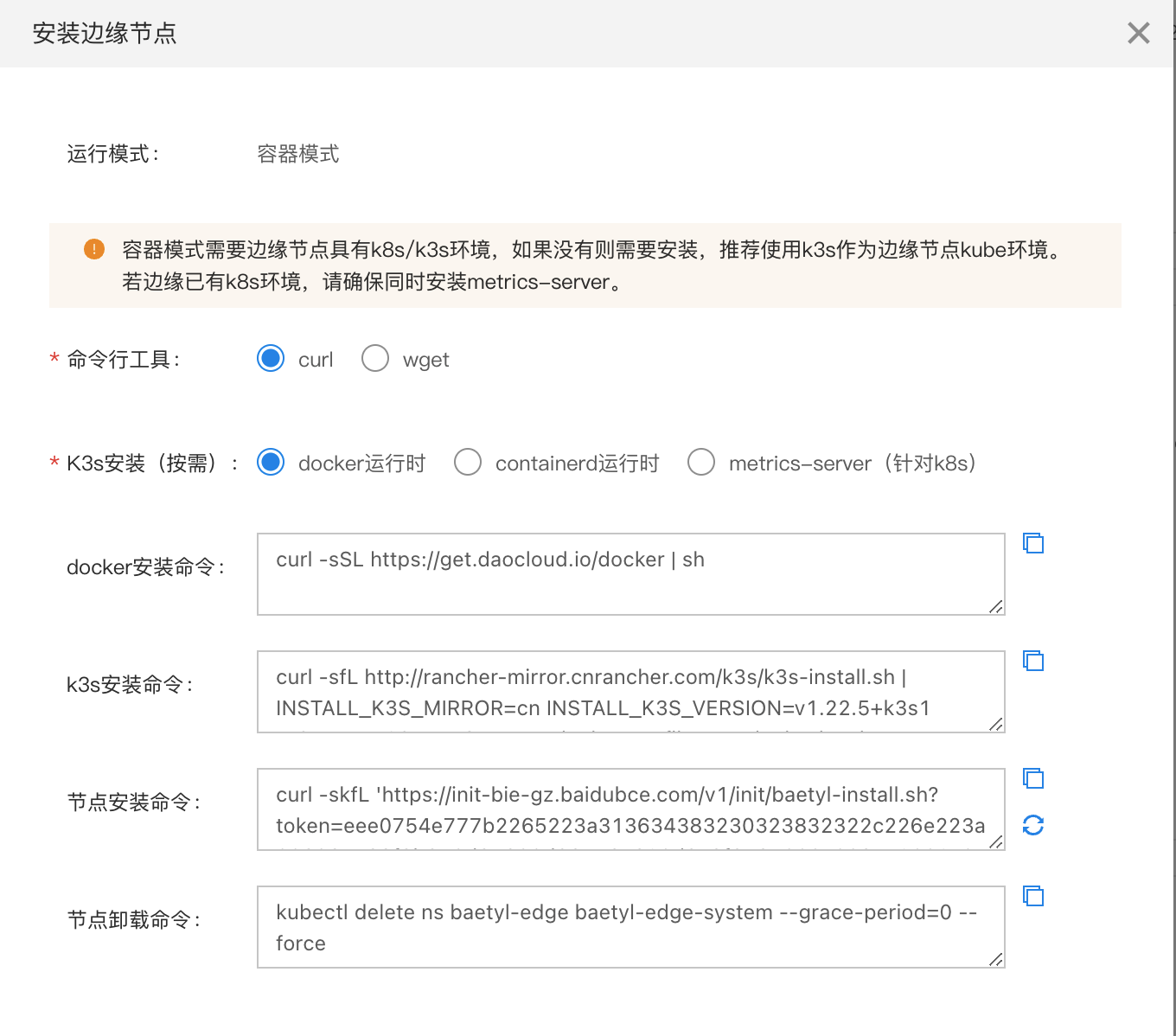

2.2 安装边缘计算框架

点击边缘节点,进入到节点详情界面,点击安装,在弹框中复制边缘计算框架安装命令,如下图所示:

在边缘节点执行在线安装命令,命令会自定下载安装包并执行安装,前提条件是边缘设备能够连接互联网。

3 验证边缘计算框架是否成功安装

安装边缘计算框架以后,执行一下命令:

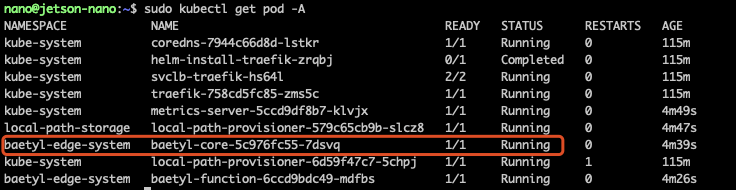

1sudo kubectl get pod -A检查发现baetyl-core这个pod是否正常启动,如下图所示,baetyl-core处于Running状态,表示边缘计算框架安装成功。

可以通过以下命令查看baetyl-core的日志与描述:

1sudo kubectl logs baetyl-core-5c976fc55-7dsvq -n baetyl-edge-system

2sudo kubectl describe baetyl-core-5c976fc55-7dsvq -n baetyl-edge-system注意:baetyl-core-5c976fc55-7dsvq 最后的随机数需要被替换为实际的值。

4、云端查看边缘节点

在创建成功以后,点击边缘节点,进入节点详情界面。可以查看节点信息、应用部署、子设备管理、节点影子,子设备管理与节点影子请参见相关具体章节,以下简单介绍节点信息与应用部署:

4.1 节点信息

节点信息主要包含:

-

系统信息

- 主机名

- 主机ID

- 操作系统

- CPU架构:例如arm64,amd64

- 硬件规则:内存容量与CPU核数

- k3s/k8s版本

- 容器版本:docker,containerd

- 外网IP

- 内网IP:

-

边缘版本

- 当前版本

- 最新版本:可升级最新版本

-

节点资源监控

- CPU使用率

- 内存使用率

- 磁盘使用率

- 网络流量上行

- 网络流量下行

-

节点标签

- 边缘节点标签,默认会有一个baetyl-node-name的系统标签。

4.2 应用部署

应用部署信息包含:

-

应用状态

- 应用部署名称

- 应用类型

- 期望版本

- 上报版本

- 节点标签

- 描述

- 部署状态

- 创建时间

-

服务状态

- 副本名称:1个服务可以有多副本,副本名称=服务名称+随机数

- 负载类型

- 运行状态

- 内存:服务副本使用的内存大小

- CPU:副本使用的CPU核数

- 访问量

- 所属应用:服务所属的应用

- 服务访问量监控

- 监控插件