基础使用

更新时间:2025-08-21

前提条件

- 已创建 Hadoop 类型集群,并选择了 Trino 服务,创建集群详情请参见创建集群。或者 已创建 Trino 类型集群。

- 如需使用 EDAP 统一元数据管理,请开通 EDAP 产品使用权限。

元数据管理

Trino支持有两种元数据管理方式,一种是使用 DEFAULT 元数据管理,一种是使用 EDAP 元数据管理。

- DEFAULT 元数据管理:默认的数据源是本集群 Hive Meta Store,若要查询其它数据源,需要在集群上手动添加 connector 配置文件到${TRINO_HOME}/etc/catalog目录下并同步到所有节点,然后重启 Trino 服务,参考官网文档。

- EDAP 元数据管理:当使用EDAP 元数据管理时,需要在edap中添加数据源,trino服务对数据源实行动态加载,不需要重启服务。

连接Trino进行查询

元数据管理为DEFAULT

- SSH登录集群 Core / Coordinator节点 ,参考SSH连接到集群

- 执行以下命令,切换用户:

Plain Text

1su hdfs- 执行以下命令进入交互式命令行:

Plain Text

1/opt/bmr/trino/bin/trino \

2--server https://{coordinator_host}:8089 - 执行以下命令,连接到数据库:

Plain Text

1use hive.default;- 创建表示例:

Plain Text

1create table test(id bigint, name varchar); - 插入数据示例:

Plain Text

1insert into test values(1,'aa'),(2,'bb');- 查询数据示例:

Plain Text

1select * from test; 元数据管理为EDAP

- SSH登录集群 Core / Coordinator节点 ,参考SSH连接到集群

- 执行以下命令,切换用户:

Plain Text

1su hdfs- 执行以下命令进入交互式命令行:

Plain Text

1/opt/bmr/trino/bin/trino \

2--server http://{coordinator_host}:8089 \

3--catalog edap_physical_tbl \

4--extra-credential access_key={accessKey} \ // accessKey的是/etc/hadoop/conf/core-site.xml fs.bos.access.key

5--extra-credential secret_key={accessSecret} \ // accessSecret的是/etc/hadoop/conf/core-site.xml fs.bos.secret.access.key

6--extra-credential session_token_key="{token}" // token的是/etc/hadoop/conf/core-site.xml fs.bos.session.token.key- 执行以下命令,连接到数据库:

Plain Text

1use edap_physical_tbl.{database};- 查询 EDAP 管理的表示例:

Plain Text

1select * from test; 连接安全模式集群

BMR 支持创建安全模式的 Hadoop / Trino 集群,连接安全模式集群时,需要使用https协议访问7778端口,还需要添加安全认证参数。示例如下:

Plain Text

1/opt/bmr/trino/bin/trino \

2// ${coordinator_host}请使用CanonicalHostName,同/opt/bmr/trino/etc/config.properties http-server.authentication.krb5.principal-hostname

3--server https://{coordinator_host}:7778 \

4--krb5-config-path /etc/krb5.conf \

5// 可以执行`klist -kt /etc/security/keytabs/hdfs.headless.keytab`获取

6--krb5-principal hdfs@BAIDU.COM \

7--krb5-keytab-path /etc/security/keytabs/hdfs.headless.keytab \

8--krb5-remote-service-name trino \

9--keystore-path /etc/security/keytabs/keystore.jks \

10--keystore-password {http-server.https.keystore.key} \ // http-server.https.keystore.key的值在/opt/bmr/trino/etc/config.properties中

11--user hdfs@BAIDU.COM \查看日志

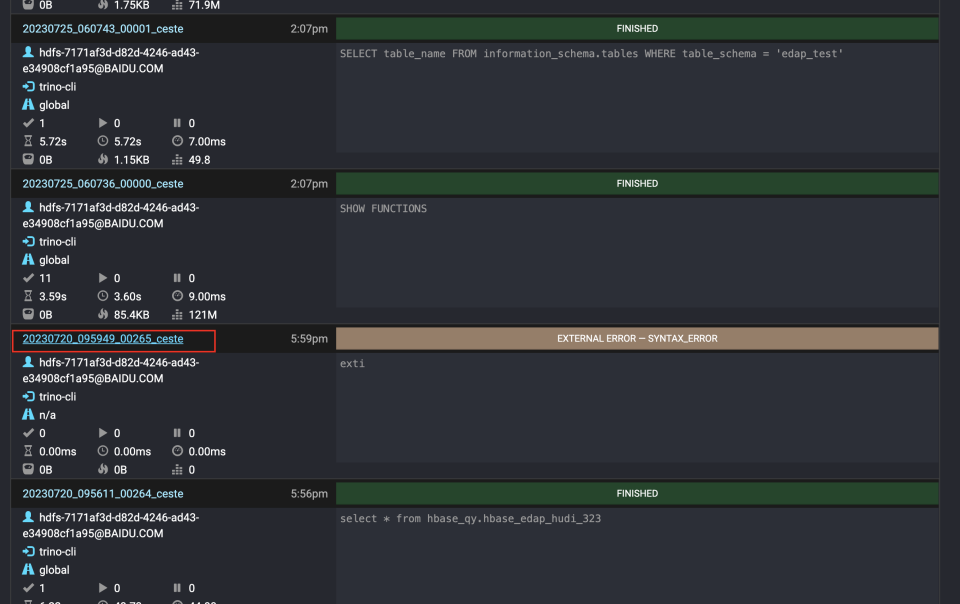

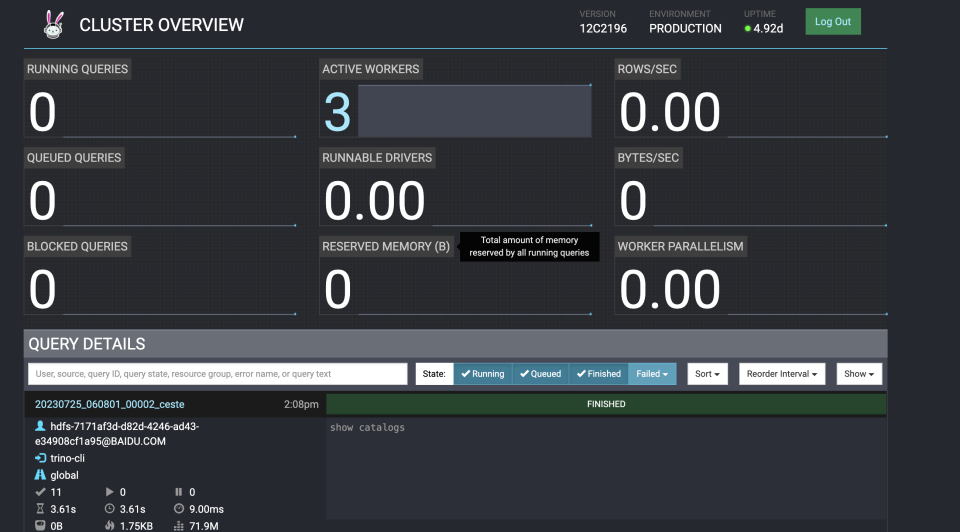

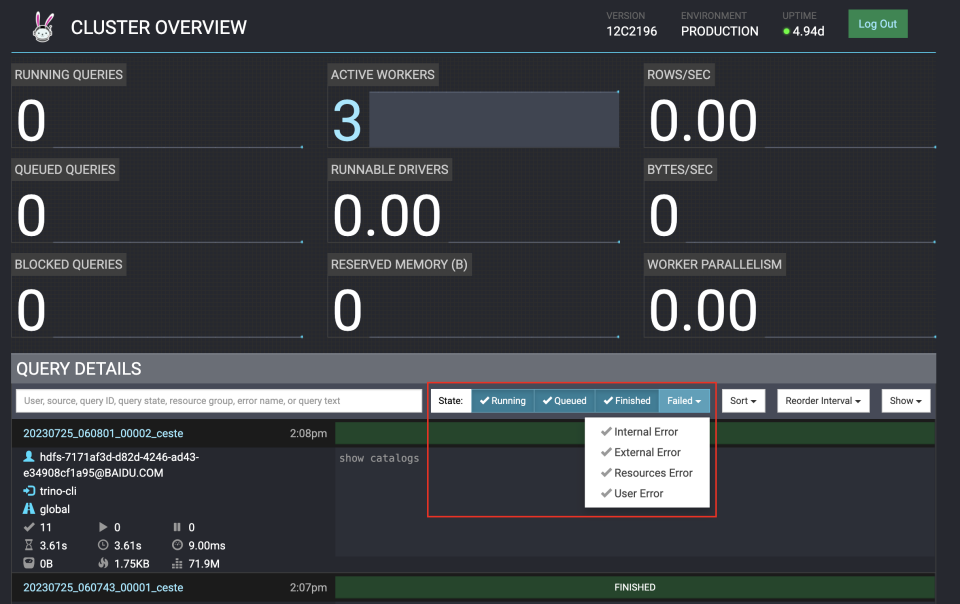

- 通过 百度云 BMR 控制台 集群列表>>集群详情>>相关应用和工具>>Trino Url,进入Trino UI。

- 通过页面的state选项可以对查询任务进行筛选。

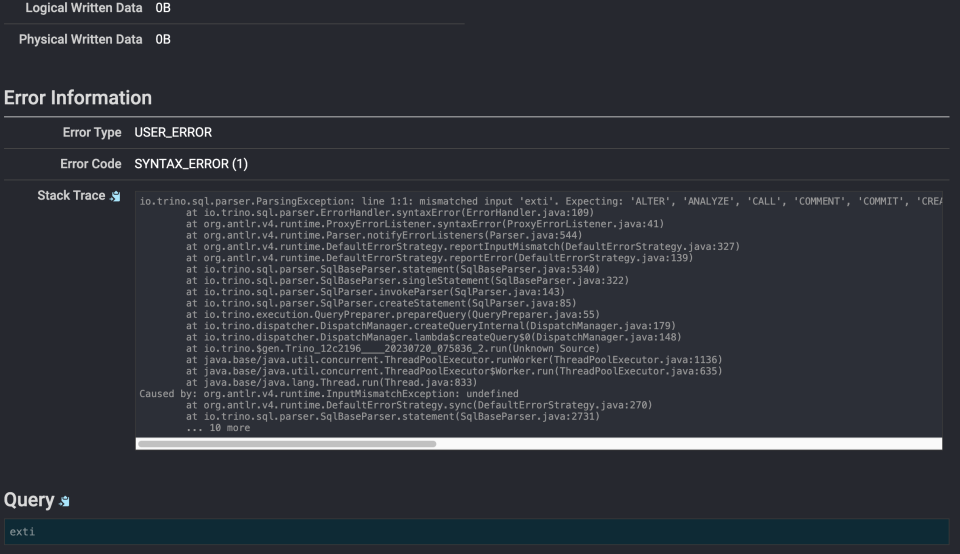

- 点击查询编号,可以进一步查看查询详情和报错日志.