镜像使用

更新时间:2025-08-21

GPU专用镜像使用说明

GPU专用镜像中,会集成GPU驱动、CUDA、cuDNN、主流深度学习框架等,具体信息如下:

| GPU专用镜像 | CUDA版本 | cuDNN | 深度学习框架版本 |

|---|---|---|---|

| Ubuntu 16.04 LTS amd64 (64bit)-CUDA9.2 | CUDA 9.2 | cuDNN 7.1.4 | 无 |

| Ubuntu 16.04 LTS amd64 (64bit)-CUDA8.0 | CUDA 8.0 | cuDNN_v5.1、cuDNN_v6 | 无 |

| 16.04 LTS amd64 (64bit)-CUDA9.0-深度学习开发镜像 | CUDA 9.0 | cuDNN 7.1.4 | TensorFlow_gpu 1.10.1、PaddlePaddle_gpu 0.14.0、Caffe2 |

| Ubuntu 16.04 LTS amd64 (64bit)-CUDA8.0-paddlepaddle_0.11.0 | CUDA 8.0 | cuDNN 7.0 | PaddlePaddle_gpu 0.11.0 |

| Ubuntu 16.04 LTS amd64 (64bit)-CUDA8.0-tensorflow_1.3.0 | CUDA 8.0 | cuDNN 7.0 | TensorFlow_gpu 1.3.0 |

| CentOS 7.5 x86_64 (64bit)-CUDA10.0 | CUDA 10.0 | 无 | 无 |

| CentOS 7.5 x86_64 (64bit)-CUDA9.2 | CUDA 9.2 | cuDNN 7.1.4 | 无 |

| CentOS 6.8 x86_64 (64bit)-CUDA9.2 | CUDA 9.2 | cuDNN 7.1.4 | 无 |

使用说明:

- 如果您购买的是英伟达Tesla V100 GPU卡,请选择CUDA 9.2版本的镜像创建GPU实例,使用CUDA 8.0版本镜像会导致GPU实例中无法识别到V100的GPU卡。

- 在您使用16.04 LTS amd64 (64bit)-CUDA9.0-深度学习开发镜像时,我们帮您预装了多个框架,在使用时需要通过source 沙箱方式使用,例如如需使用Caffe2环境,需要采用如下方式 # source /home/Caffe2-py27/bin/activate 切换。

- 没有安装深度学习框架的GPU专用镜像中,cuDNN已下载到 /home/work/cudnn/ 目录中,需要您手动安装,可参考英伟达官方文档:https://docs.nvidia.com/deeplearning/sdk/cudnn-install/index.html。如您需要其他版本的cuDNN,也可自行下载:https://developer.nvidia.com/rdp/cudnn-download。

公共镜像使用步骤

BCC公共镜像,不包含GPU驱动的官方发行版本,需要用户自行安装NVIDIA GPU驱动,可参考如下方式:

下载GPU驱动:

- 在NVIDIA官方网站下载与实例包含GPU型号相对应的驱动程序。地址:http://www.nvidia.com/Download/index.aspx?lang=cn 。

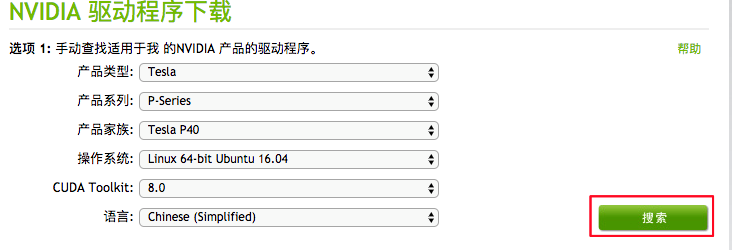

-

手动查找适用于GPU实例的驱动程序,主要注意GPU型号和操作系统版本:

- 点击搜索按钮进入下载页面。

-

核实信息后,点击下载,将驱动程序下载到本地。

-

将驱动程序上传到云主机中,并按照NVIDIA官网提示进行安装:

- 自2017年12月19日,暂停提供GPU实例对于Windows进行的支持,用户将无法选择Windows镜像创建新的GPU实例,后续开放Windows镜像支持时间请关注官方公告。